Gratuits et faciles d'accès, les agents conversationnels alimentés par l'intelligence artificielle (IA) fournissent des réponses en quelques secondes. Toutefois, ces réponses instantanées sont-elles fiables?

Une grande partie du contenu de santé offert par ces agents conversationnels au grand public n'est pas fondée sur des preuves rigoureuses, affirme Nicholas Jacobson, professeur agrégé de science des données biomédicales, de psychiatrie et d'informatique à la Geisel School of Medicine du Dartmouth College, au New Hampshire.

Ils n’ont tout simplement pas été entraînés pour donner des conseils de santé, dit-il.

C'est là un fait dont de nombreux utilisateurs ne se rendent peut-être pas compte.

Seulement le quart de la population canadienne aurait confiance en l'exactitude des informations fournies par les agents conversationnels alimentés par l'IA sur la santé, selon un sondage de l'Association médicale canadienne.

De plus, les personnes qui ont suivi des conseils de santé générés par l'IA étaient cinq fois plus susceptibles de recevoir de mauvaises suggestions que celles qui ne l’avaient pas fait.

Dans nos pires moments, on est prêts à accepter de l’aide, peu importe la forme. Mais quand on est vulnérables, on est encore moins en position de juger la qualité de l'aide qu'on reçoit, ajoute le médecin de famille Vincent Dumouchel.

C’est la raison pour laquelle lui-même et d’autres chercheurs cherchent des solutions pour amener l’IA à devenir un outil fiable en matière de santé mentale.

Un reportage de Mélanie Meloche-Holubowski à ce sujet sera présenté à l'émission Découverte diffusée sur ICI TÉLÉ samedi à 18 h 30 (HNE).

L’audit médical de l’IA

À l’hiver 2025, le Dr Dumouchel a été approché par OpenAI pour vérifier à quel point ChatGPT offre de bons conseils médicaux. Il a fait partie d’un groupe d’environ 200 médecins qui ont évalué comment cet agent conversationnel réagit aux questions des utilisateurs sur leur santé.

Avant la fin de ce processus, OpenAI a lancé le HealthBench. Il s’agit d’un vaste ensemble de données qui permet aux chercheurs de tester la capacité de différents modèles d’IA à répondre à des questions liées aux soins de santé. Ils peuvent ainsi soumettre à ces modèles des cas médicaux complexes et voir si les réponses fournies aux questions des utilisateurs sont fiables, sûres et utiles.

Le PDG de ChatGPT, Sam Altman, a annoncé (nouvelle fenêtre) lors du lancement du modèle 5.0 du robot conversationnel qu'il avait testé sa version la plus récente et a affirmé qu’il s’agissait du meilleur modèle jamais conçu pour la santé et qu’il surpass[ait] les capacités des médecins.

C’est à ce moment-là que Vincent Dumouchel a eu des doutes : une entreprise en IA peut-elle vraiment évaluer la sûreté médicale de ses propres modèles?

C'est là qu'il y a eu rupture du lien de confiance. Il n'y a rien de scientifique au fait de dire qu’on respecte des critères alors que c’est eux-mêmes qui ont établi ces critères. C’est facile de dire que ta version est sécuritaire… Mais selon qui? Selon toi-même.

Une citation deLe Dr Vincent Dumouchel, Vetted Medical

Le Dr Dumouchel a alors renoncé à son rôle de consultant auprès d'OpenAI. Je me suis dit qu’il faut des gens à l’externe pour remettre en question les affirmations de ces compagnies d'intelligence artificielle, et qui de mieux que des personnes dans le domaine de la santé?

Aujourd’hui, sa firme, Vetted Medical, composée de médecins auditeurs d'intelligence artificielle, a pour mission d'aider les décideurs à évaluer les promesses des vendeurs d'IA en effectuant une revue médicale diligente et rigoureuse.

On relève les failles, un peu comme les comptables le font pour les états financiers, affirme le Dr Dumouchel à titre d'illustration.

Il collabore aussi avec l’Institut québécois de recherche en intelligence artificielle (Mila) sur un projet destiné à sécuriser les robots conversationnels en santé mentale.

Pour le Dr Dumouchel, il est impératif que les entreprises soient plus transparentes à l'endroit de leurs utilisateurs : l’IA n’est pas conçue pour être un médecin ou un thérapeute, et elle peut donner de faux conseils.

Il y a un risque que le conseil [de santé] ne soit pas éprouvé et que l'engin n'ait pas été approuvé [comme un outil technologique pour la santé] par un organisme réglementaire comme Santé Canada ou la FDA [Agence américaine des médicaments, souligne-t-il.

Il rappelle que l'industrie pharmaceutique doit suivre de rigoureux processus d’études cliniques avant d’obtenir des autorisations pour la mise en marché de produits médicaux. Alors, pourquoi permettre la mise en marché de produits technologiques sans en avoir étudié les risques potentiels pour la santé?

C'est comme si, demain matin, on avait décidé de lancer un nouveau médicament mais qu'on allait étudier les effets plus tard.

Avant même l’arrivée de ChatGPT, Nicholas Jacobson et ses collègues du Dartmouth College avaient eu l’idée de créer un robot conversationnel axé spécifiquement sur la santé mentale.

Je pense que les agents conversationnels alimentés par l'IA peuvent être bénéfiques, mais ils doivent être adaptés, dit M. Jacobson.

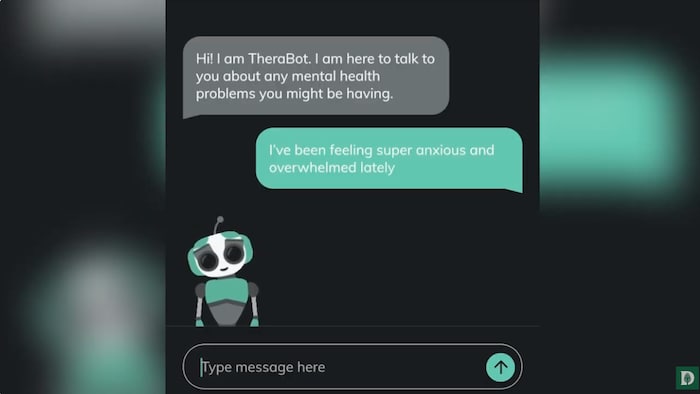

Appelé Therabot, leur petit avatar animé a été conçu pour offrir de la thérapie cognitivo-comportementale.

L'algorithme de Therabot a été entraîné pendant 100 000 heures à l’aide d’études révisées par des pairs. Ce robot a aussi été entraîné en visionnant des séances de thérapie.

Contrairement aux agents conversationnels comme ChatGPT, Therabot n’a pas une personnalité flagorneuse, un trait qui serait lié à des cas de psychoses induites par l’IA.

Les agents conversationnels comme ChatGPT sont conçus pour ne pas contredire l’utilisateur, quitte à valider de fausses idées. Tout pour le garder engagé.

Cependant, cette attitude complaisante n’est pas toujours adéquate en santé mentale. Parfois, le thérapeute doit remuer son patient ou le faire sortir de sa zone de confort.

Beaucoup de gens utilisent les robots conversationnels parce que leurs sentiments sont validés. Et ça peut leur sembler très utile. Malheureusement, même s'ils semblent utiles, ils sont souvent nuisibles. Je pense que les gens ne veulent pas toujours entendre ce qui serait préférable pour eux…, ajoute M. Jacobson.

Si Therabot n’est pas encore disponible pour le grand public, des tests auprès de personnes avec des symptômes de dépression et d’anxiété ont donné des résultats prometteurs (nouvelle fenêtre). Nous avons constaté que les personnes qui avaient accès à Therabot présentaient des changements remarquables dans la réduction des symptômes de dépression, d'anxiété et de troubles alimentaires.

De la thérapie avec des avatars

Dire qu’un chatbot à lui seul va offrir une thérapie, je ne pense pas que ce soit le cas en ce moment. Je pense qu'il reste plein de choses qu'on perçoit comme êtres humains que les chatbots ne perçoivent pas, affirme le Dr Alexandre Dumais, psychiatre à l'Institut national de psychiatrie légale Philippe-Pinel et chercheur au centre de recherche de l’Institut universitaire en santé mentale de Montréal.

Le Dr Dumais comprend toutefois pourquoi les gens sont attirés par ces outils.

Dans sa pratique, il observe comment les humains préfèrent parfois se confier à une machine plutôt qu’à une personne.

Le Dr Dumais a élaboré la thérapie par avatar il y a une dizaine d’années, d'abord pour traiter la schizophrénie, puis la dépendance au cannabis et la dépression grave.

Ces personnes sont souvent malades depuis des années. En moyenne, elles ont pris huit médicaments, elles ont fait trois psychothérapies, mais ça ne fonctionne pas, explique le psychiatre.

Le Dr Dumais leur offre une thérapie de réalité virtuelle. Grâce à un avatar, le patient affronte ses démons, une personne influente dans sa dépendance ou même un proche décédé.

Les patients se surprennent eux-mêmes à quel point ils sont comme portés par le jeu.

Une citation deLe Dr Alexandre Dumais, Institut national de psychiatrie légale Philippe-Pinel

Généralement, quelques séances suffisent pour provoquer un changement.

Contrairement aux agents conversationnels comme ChatGPT ou Replika, il y a toujours un humain aux commandes.

Le thérapeute peut juger quand ça va trop loin, explique le Dr Dumais. Le but, ce n'est pas de renforcer des croyances, des distorsions cognitives, des délires chez les patients. On les accompagne pour les faire cheminer.

Intégrer l’IA aux avatars est la prochaine étape de son projet. Je pense que ça peut nous permettre d'enlever les zones d'ombre et de nous ouvrir les œillères pour pouvoir offrir de meilleurs traitements.

Puisque les traitements reposent souvent sur un processus d’essais-erreurs, le Dr Dumais croit que l’IA pourrait aider à mieux prédire si un traitement sera efficace chez des patients dont les cas sont plus complexes.

L’IA pour affiner la recherche

D’ailleurs, le neuropsychiatre Simon Ducharme est convaincu que l’IA peut éclairer ces zones d’ombre et faire avancer la recherche en psychiatrie.

La psychiatrie, c'est une science clinique qui s'appuie sur une complexité infinie de facteurs. Si on veut tout intégrer, ça nous prend des méthodes d'analyse d'intelligence artificielle, dit M. Ducharme, qui est aussi clinicien-chercheur à l’Institut de recherche du Centre universitaire de santé McGill (CUSM).

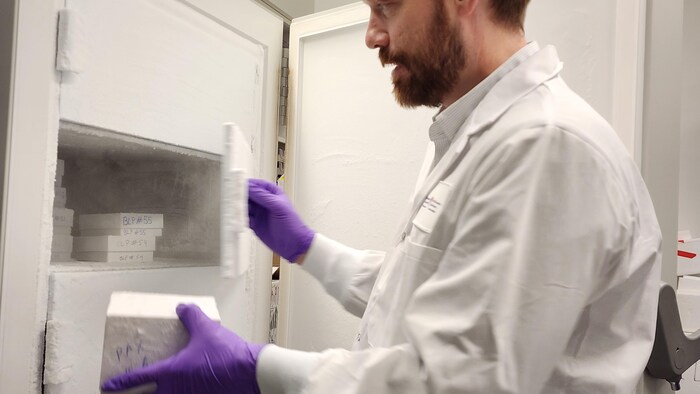

Il est également directeur scientifique du Centre pour la psychiatrie de précision du Québec et mène le projet de biobanque SPARK (Solutions for Psychiatric AI Research & Knowledge).

Le but? Récolter des données biologiques (cheveux et sang), psychologiques, sociales et médicales (imagerie cérébrale) chez plus de 2000 patients qui souffrent de troubles psychiatriques.

Ces échantillons sont conservés dans un congélateur et offerts aux chercheurs qui souhaitent analyser les données.

L'IA, croit le Dr Ducharme, pourrait détecter dans ces données certains signes subtils qui passent inaperçus aux yeux d’un humain. Cela ouvrira potentiellement la voie à l’identification de sous-types de troubles, à l’élaboration de diagnostics plus précis et à des traitements plus personnalisés.

C’est ce qu’on appelle de la psychiatrie de précision.

Comme le Dr Dumais, le Dr Ducharme ne croit pas que l’IA remplacera de sitôt les experts en santé mentale.

La psychiatrie, ça demeure quelque chose de très relationnel. L’IA peut avoir toutes les connaissances du monde, mais il faut quelqu’un pour entretenir cette relation, pour suggérer un traitement. Je pense que ça va complémenter [notre pratique], mais je ne vois pas l'IA remplacer les psychiatres à court ou moyen terme.

Avec la collaboration de Bouchra Ouatik